{{item.title}}

{{item.text}}

{{item.title}}

{{item.text}}

L'intelligence artificielle (IA) fait désormais partie intégrante de nos vies personnelles et professionnelles. Pourtant, elle suscite souvent des inquiétudes et des réserves. Que se passe-t-il si votre application à commande vocale enregistre toutes vos conversations ? Ou si votre assistant de conduite automatisé prend des décisions qui semblent imprévisibles ? Pour éviter de tels scénarios, il est essentiel de développer, d'exploiter et de maintenir des systèmes d'IA responsables .

Chez PwC Suisse, nous nous engageons à exploiter le vaste potentiel de l'IA tout en garantissant son utilisation responsable et éthique. Nos services Trust in AI sont conçus pour inspirer confiance dans vos initiatives d'IA en validant et en affinant rigoureusement les modèles afin de fournir des résultats optimaux . Avec un engagement fort pour des pratiques d'IA responsables, nous aidons les organisations à naviguer dans le paysage complexe de l'intelligence artificielle, en promouvant la transparence, l'équité et la responsabilité dans le déploiement des solutions d'IA. La confiance dans l'IA commence avec PwC Suisse.

Participez à notre enquête pour mieux comprendre votre situation actuelle, vous comparer à vos pairs et façonner l'avenir de l'IA responsable.

Veuillez noter que l'enquête est en anglais.

L'IA offre d'énormes possibilités, mais son intégration dans une organisation comporte également des risques. Nous nous engageons à aider nos clients à gérer efficacement ces défis et à mettre en place un cadre responsable en matière d'IA.

Yan BorboënPartner, Leader Digital Assurance, PwC SuisseComme tout outil puissant, l'adoption de l'IA comporte des risques inhérents. Les entreprises doivent trouver un équilibre entre rapidité et confiance lorsqu'elles mettent en œuvre l'IA, en veillant à adopter une approche fondée sur les risques, afin d'obtenir des avantages concurrentiels et de conserver la confiance des parties prenantes. Une gestion efficace des risques est essentielle pour tirer pleinement parti de cette technologie transformatrice.

Les discussions sur les aspects éthiques de l'IA, tels que le risque de "deepfakes", de partialité et de violation de la propriété intellectuelle, sont cruciales. Les craintes concernant l'impact de la technologie sur l'emploi et sa capacité à remplacer certains aspects de l'intelligence humaine doivent également être prises au sérieux.

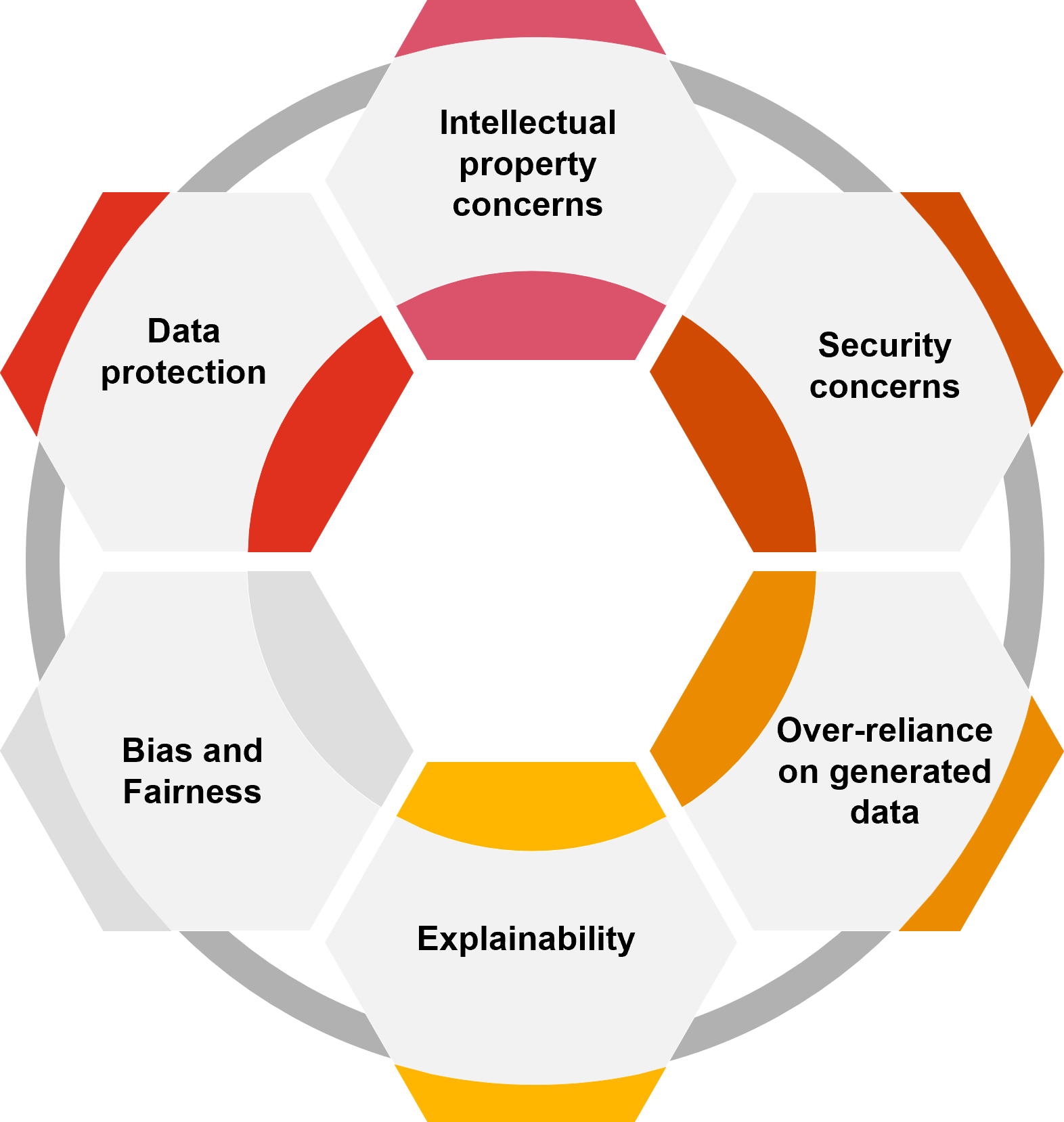

Pour susciter la confiance dans l'utilisation de l'IA, il faut bien comprendre les risques ( ) et adopter une approche ciblée pour y répondre - ainsi qu'aux préoccupations des parties prenantes . Ce n'est qu'en mettant l'accent sur l'implication humaine, la robustesse, l'équité, la sécurité, la protection de la vie privée et la gouvernance que les entreprises pourront naviguer habilement dans le paysage de l'IA et en exploiter tout le potentiel.

Pour en savoir plus sur les risques liés à l'IA, consultez notre blog. Comment votre organisation gère-t-elle l'IA ?

Le traitement des informations générées par l'IA nécessite un regard prudent. . Deux des préoccupations liées à l'IA sont la protection des données et les problèmes de propriété intellectuelle (PI) , qui peuvent entraîner des problèmes juridiques. Une autre préoccupation importante concerne les données sur lesquelles le modèle est formé. S'il est formé sur des données biaisées, ses résultats risquent de refléter les mêmes biais. Il est donc essentiel que les organisations examinent attentivement les ensembles de données qui sous-tendent leur IA afin de garantir l'équité, la neutralité et la pertinence.

Une telle approche de l'IA fondée sur les risques ouvre également la voie à une relation positive avec les régulateurs, les consommateurs et les autres parties prenantes.

Favoriser la confiance dans un monde régi par l'IA nécessite une vision et une compréhension globales des risques potentiels à tous les stades du cycle de vie de l'IA, ainsi qu'une approche stratégique visant à atténuer ces risques de manière proactive.

Morgan BadoudSenior Manager Digital Assurance, PwC SuisseComme nous construisons des solutions d'IA depuis 2016, nous avons identifié six domaines clés de risque et la meilleure façon de les traiter :

Protection des données

Les principales considérations relatives à la protection des données comprennent la réalisation d'évaluations complètes des risques, la garantie de la transparence, l'obtention d'un consentement éclairé, le contrôle vigilant de la partialité, la mise en œuvre de politiques de conservation des données, ainsi que l'examen et la mise à jour réguliers de ces politiques afin d'en assurer la conformité et la sécurité.

Préoccupations en matière de sécurité

Pour répondre aux problèmes de sécurité de l'IA, il faut évaluer les risques potentiels, mettre en place des contrôles de sécurité solides, former les employés aux meilleures pratiques en matière de sécurité, maintenir les logiciels à jour avec des correctifs réguliers et recourir à la validation par des tiers pour renforcer les mesures de sécurité.

Dépendance excessive à l'égard des données générées

Pour limiter le risque d'une dépendance excessive à l'égard des données générées, il est important d'informer les parties prenantes sur les limites de l'IA, d'établir des lignes directrices claires pour son utilisation, de valider les données générées par rapport à des sources de données réelles et de contrôler et revoir en permanence l'utilisation des données générées dans les processus de prise de décision.

Explicabilité

Pour répondre aux préoccupations relatives à l'explicabilité des modèles, il est important de reconnaître les limites du modèle et de ses données d'apprentissage. Utilisez des modèles interprétables dans la mesure du possible, procédez à des évaluations approfondies des modèles et tenez-vous au courant des derniers développements en matière de techniques d'IA explicable afin d'améliorer la transparence et la compréhension.

Les modèles et algorithmes d'IA créent des données originales en identifiant des modèles dans des ensembles de données existants. Ces modèles produisent des résultats qui reflètent les données d'entrée de l'apprentissage, mais qui présentent des variations distinctives. Les applications sont vastes et diverses : génération d'images, synthèse de texte et de parole, composition musicale, etc. Mais elles comportent également un risque de biais si elles ne sont pas correctement formées et validées. Malgré ces difficultés, les modèles d'IA sont appelés à jouer un rôle croissant dans la génération de données et la prise de décision pour tous les secteurs et toutes les applications.

Des campagnes de marketing hyperpersonnalisées et l'amélioration de l'expérience client, à la rationalisation des opérations commerciales, la gestion de la main-d'œuvre et l'optimisation de la chaîne d'approvisionnement, en passant par la détection des fraudes et les questions juridiques, l'IA révolutionne de nombreux secteurs d'activité.

Au fond, l'utilisation responsable de l'IA est tout simplement une bonne science des données, guidée par des principes clés, de la stratégie à l'exécution. Ces principes comportent quatre dimensions :

Plongez dans l'éthique des données et de l'utilisation de l'IA, et intégrez-les dans vos valeurs organisationnelles. Gardez une longueur d'avance en matière de politique et de réglementation en anticipant et en comprenant les évolutions politiques et réglementaires critiques, permettant l'alignement sur les processus de conformité pour une mise en œuvre responsable de l'IA.

En termes de gouvernance, il est essentiel de mettre en place des mécanismes de contrôle qui englobent les trois lignes de défense de votre organisation. En matière de conformité, donnez la priorité au respect des réglementations, des politiques organisationnelles internes et des normes industrielles. Dans le cadre de la gestion des risques, étendez vos pratiques traditionnelles de détection et d'atténuation des risques pour traiter efficacement les risques uniques et les dommages potentiels associés aux technologies de l'IA.

Lors de la mise en œuvre de l'IA, il est important de veiller à l'interprétabilité et à la transparence ; les modèles d'IA doivent prendre des décisions transparentes pour être bien compris. La durabilité doit être une priorité, l'objectif étant de réduire l'impact sur l'environnement. Les systèmes d'IA doivent être robustes et fiables, tout en tenant compte des biais potentiels et en garantissant l'équité. La cybersécurité est essentielle pour se protéger des menaces, et les préoccupations en matière de vie privée doivent être prises en compte par des mesures de protection des données. Enfin, la sécurité est essentielle, les systèmes d'IA devant être conçus et testés pour prévenir les dommages physiques et garantir une utilisation sûre.

Définir clairement le problème spécifique et évaluer si l'IA/ML est la solution appropriée. Respecter les meilleures pratiques et normes du secteur pour garantir la cohérence et la qualité. Évaluer en permanence les performances du modèle et procéder à des améliorations itératives pour améliorer les mesures. Mettre en œuvre une surveillance continue pour identifier les changements de performance et les risques potentiels.

Le paysage de l'IA est plein de frontières ouvertes, offrant de vastes opportunités, mais aussi des défis importants. Il est essentiel d'adopter une approche prudente de l'IA, en veillant à ce que l'éthique et l'apport humain restent au centre des préoccupations. Il est essentiel de fonder les systèmes d'IA sur des bases éthiques solides, compte tenu de leur impact sur tous les utilisateurs.

Nos équipes pluridisciplinaires, dotées d'une grande expérience dans la conception et la mise en œuvre de solutions d'IA, vous guideront à travers les étapes critiques et vous fourniront un soutien continu alors que vous vous engagez dans une transformation réussie de l'IA. Notre approche de l'IA repose sur quatre piliers : l'habilitation, l'évaluation de l'adéquation, l'assurance par un tiers et l'éducation.

Faites confiance à la transformation - et faites confiance à un partenaire doté d'une expertise approfondie en matière d'intelligence artificielle, qui travaillera en étroite collaboration avec vous pour intégrer avec succès la technologie clé de la prochaine décennie dans votre entreprise.

Pour rester compétitives à l'ère du numérique, les entreprises doivent adopter une approche stratégique de l'IA axée sur la sécurité et la transparence. De nombreux projets d'IA échouent rapidement, souvent en raison d'une confiance numérique insuffisante tout au long du cycle de vie de l'IA, notamment en ce qui concerne la protection des données, les biais dans l'entraînement des modèles et les incertitudes quant aux performances et à la robustesse de l'IA. Le succès dépend de la définition et de la mise en œuvre des bonnes stratégies organisationnelles et technologiques dans les services et les produits. Nous vous guidons à travers les étapes nécessaires pour réaliser le plein potentiel de l'IA et vous accompagnons sur le chemin d'une transformation réussie de l'IA.

PwC accélère son engagement dans la technologie de l'IA, en forgeant des partenariats industriels, en se concentrant sur la formation et en améliorant ses services aux clients - des initiatives qui nous ont déjà permis de nous positionner en tant que précurseur dans le domaine de l'IA. Notre approche de la mise en œuvre de l'IA dans les entreprises est fondée sur la confiance et l'obtention de résultats. Ces principes constituent l'épine dorsale de nos innovations en laboratoire et de nos solutions tangibles en matière d'IA.

Outre notre engagement direct auprès des entreprises, nous participons activement aux discussions et aux organes qui façonnent les normes et les pratiques éthiques de l'IA responsable.

Contactez nos experts en IA pour découvrir comment PwC peut vous aider à utiliser l'IA de manière responsable et à exploiter son potentiel de manière éthique et consciencieuse.

https://pages.pwc.ch/core-contact-page?form_id=7014L000000IIaSQAW&embed=true&lang=fr

Partner, Leader Digital Assurance & Trust and Cybersecurity & Privacy, PwC Switzerland

+41 58 792 84 59